Qu’est-ce qu’un système d’intelligence artificielle ?

Comprendre pour maîtriser les risques et la conformité

L’intelligence artificielle est aujourd’hui au cœur des transformations numériques. Mais derrière ce terme souvent flou se cache une réalité technique et réglementaire précise. Comprendre ce qu’est réellement un système d’IA est indispensable pour en maîtriser les risques, répondre aux exigences du règlement européen (AI Act) et sécuriser ses usages.

Une définition simple (mais essentielle)

Un système d’intelligence artificielle est un système informatique capable de produire des résultats (prédictions, recommandations, décisions) à partir de données, en s’appuyant sur des modèles algorithmiques.

Contrairement à un logiciel classique, un système d’IA ne suit pas uniquement des règles codées à l’avance : il apprend à partir de données et peut évoluer dans le temps.

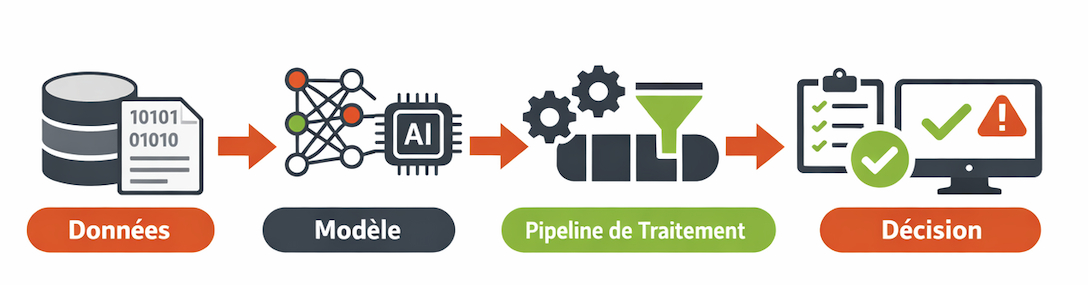

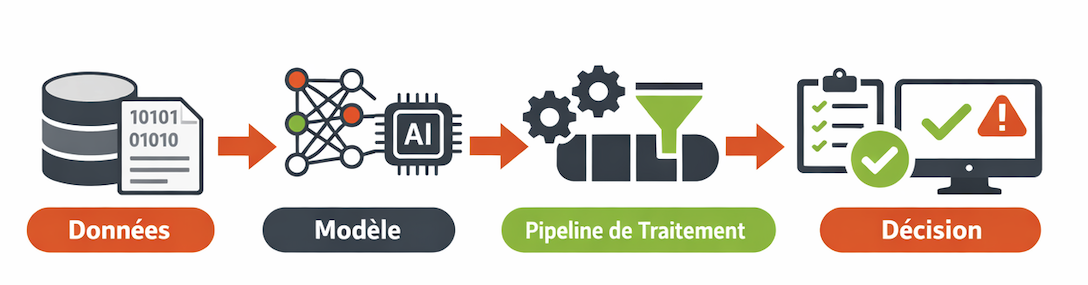

Un système d’IA transforme des données en décisions, avec un certain niveau d’autonomie.

Définition au sens du règlement européen (AI Act)

Le règlement européen sur l’intelligence artificielle (AI Act) définit un système d’IA comme un système conçu pour fonctionner avec différents niveaux d’autonomie et capable de générer des résultats influençant des environnements physiques ou virtuels.

Dès qu’un système influence une décision ou un comportement humain, il entre potentiellement dans le champ du AI Act.

Les 4 composants essentiels d’un système d’IA

1. Les données

Les données sont le carburant de l’IA. Elles peuvent être structurées (bases de données) ou non structurées (textes, images, audio).

- Qualité des données

- Représentativité

- Présence de biais

2. Le modèle

Le modèle est le cœur du système. Il apprend des patterns à partir des données pour produire des résultats.

- Modèles statistiques

- Machine learning

- IA générative (LLM)

3. Le pipeline de traitement

Le pipeline correspond à l’ensemble des étapes permettant de transformer les données en résultats : collecte, nettoyage, entraînement, inférence.

4. L’interface et les usages

C’est la manière dont l’utilisateur interagit avec le système (interface, API, automatisation).

IA classique vs IA générative : une distinction importante

Toutes les IA ne fonctionnent pas de la même manière :

- IA classique : classification, scoring, prédiction

- IA générative : production de contenu (texte, image, code)

Pourquoi cette compréhension est critique pour les organisations

Ne pas comprendre ce qu’est un système d’IA expose à plusieurs risques :

- Non-conformité réglementaire (AI Act, RGPD)

- Décisions biaisées ou injustes

- Manque de traçabilité

- Responsabilité juridique engagée

À l’inverse, une bonne compréhension permet de :

- Identifier les risques en amont

- Mettre en place une gouvernance adaptée

- Sécuriser les usages

- Valoriser l’innovation

Vers une maîtrise des risques : première étape indispensable

Comprendre les composants d’un système d’IA est la première étape pour structurer une démarche de maîtrise des risques.

Des méthodes comme HARA permettent ensuite d’analyser ces risques de manière systématique et opérationnelle.

- Cartographier vos systèmes d’IA existants

- Identifier les usages à risque

- Évaluer les impacts sur les utilisateurs

- Mettre en place un cadre d’usage

Besoin d’accompagnement sur vos systèmes d’IA ?

Nous accompagnons les entreprises et collectivités dans la mise en conformité et la maîtrise des risques liés à l’intelligence artificielle.

- Cadre d’usage responsable de l’IA

- Mise en conformité AI Act / RGPD

- Pilotage et gouvernance des systèmes IA

- Audit des systèmes d’IA